Smart & effizient

KI-Architektur & -Umsetzung. GenAI and LLM-Services. AI Security and Trust.

Krankenversicherungen, Leistungserbringer und die Industrie stehen vor der Herausforderung, Generative KI (GenAI) und Large Language Models (LLMs) sicher und werthaltig in ihre Prozesse zu integrieren. Wir unterstützen sie dabei, Potenziale zu identifizieren, geeignete Architekturen zu entwickeln und Lösungen zu implementieren, die sowohl produktivitätssteigernd als auch regulatorisch abgesichert sind.

Mit Federated Learning ermöglichen wir den sicheren Einsatz von KI auch bei kleineren Datenmengen – unter Wahrung von Datenschutz und regulatorischen Anforderungen. Deep Learning kann bspw. auf Routinedaten angewendet werden, um Muster zu erkennen und so Versorgungspfade zu optimieren, personalisierte Empfehlungen abzuleiten und frühzeitig Versorgungsbedarfe zu identifizieren.

Automatisierung wird von Kassen bereits als Lösung zur Effizienzsteigerung bzw. Verringerung der Verwaltungskosten gesehen und eingesetzt. Kassen nutzen Automatisierung zur Effizienzsteigerung und Kostensenkung. Viele Lösungen scheitern jedoch, da fachliche und technologische Anforderungen unzureichend abgestimmt sind. Core Automation vereint beide Aspekte.

Unsere Lösungen bieten sichere, skalierbare und mehrwertstiftende KI- und LLM-Nutzung, die den Arbeitsalltag von Fachkräften erleichtert, die Produktivität steigert und Entscheidungsprozesse verbessert – immer unter Berücksichtigung regulatorischer und ethischer Anforderungen.

KI-Architektur und -Umsetzung | Föderiertes Lernen

Mithilfe von Föderiertem Lernen können leistungsfähige KI-Modelle auf der Grundlage einer geringen eigenen Datenmenge angelernt werden. So ermöglichen wir den Einsatz von KI in Prozessen, in denen dies bisher schwer oder nicht möglich war. Weitere Informationen zur Methodik des Föderierten Lernens finden Sie hier in unserem _hub.

Federated AI

Leistungsfähige KI-Modelle auch mit wenigen eigenen Daten

Federated Learning lässt sich prinzipiell auf alle Prozesse anwenden, bei denen die Datengrundlage bei einzelnen Akteuren ggf. zu schwach für Machine-Learning-Algorithmen ist und Datenschutz eine große Rolle spielt, aber mehrere Akteure das gleiche Problem lösen müssen.

Dazu zählen viele der Verwaltungsprozesse bei Krankenkassen, wie z. B. die Prüfung von Anträgen (Heil-, Hilfsmittel, Fahrkostenerstattungen, Pflegeleistungen etc.) und Rechnungen. Aber auch Anwendungsfälle in der Finanzbranche, der Industrie und im öffentlichen Sektor sind umsetzbar wie bspw. betrugsanfällige Transaktionen erkennen, Produktionsausfälle vorherzusagen oder Risikobewertungen optimieren.

Wo könnte Federated Learning in Ihrem Bereich Mehrwerte schaffen? Lassen Sie uns ins Gespräch kommen – wir freuen uns auf den Austausch!

Ihr Ansprechpartner

GenAI and LLM-Services

Unser Beratungsangebot für eine smarte und sichere Nutzung von KI und LLM in Ihrer Systemlandschaft

Wir begleiten Sie ganzheitliche entlang der gesamten KI-Implementierung:

- Ersten Orientierung und Bedarfsanalyse

- Strategische Planung und Identifikation von sinnvollen und gewinnbringenden Use Cases

- Audit eines validen Einsatzes von Anwendungen

- Optimierung bestehender Lösungen

- Vorkonfigurierte KI-/LLM-Services für eine sichere und zuverlässige Nutzung

Gerne besprechen wir mit Ihnen, welche individuellen Einsatzfelder sich für Sie ergeben und beraten Sie zur sicheren und produktiven Umsetzung von Large Language Modellen (LLMs). Hier finden Sie weitere umfangreiche Informationen.

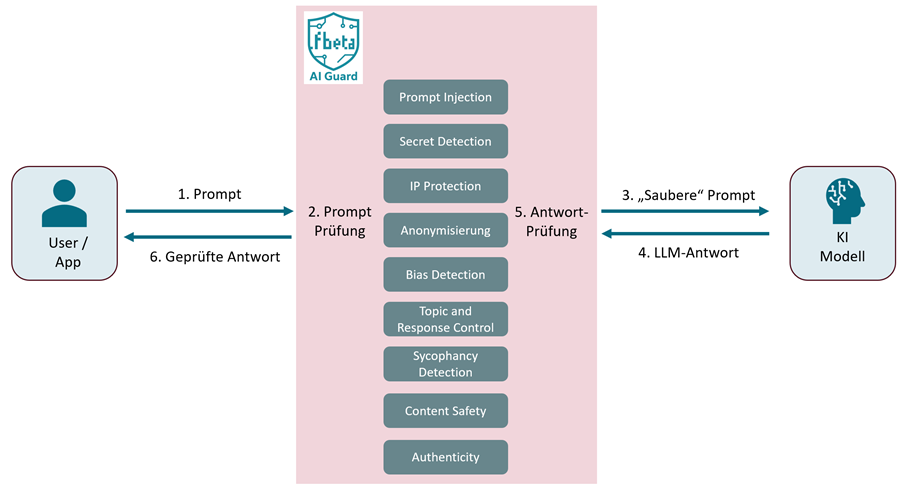

AI Security and Trust | Der _fbeta AI Guard

Unternehmen und Organisationen setzen zunehmend künstliche Intelligenz ein. Was dabei oft unterschätzt wird: KI-Systeme bergen eine Reihe von Risiken, so dass bei der Nutzung von KI schnell Sicherheitslücken und Datenschutzrisiken entstehen – mit realen Folgen für Vertrauen, Compliance und Produktstrategie. Daher müssen neben allgemeinen klassischen IT-Sicherheitsrisiken auch KI-spezifische Bedrohungen immer adressiert werden.

Übrigens: Diese Berücksichtigung ist auch regulatorisch gefordert. So ist dies explizit im AI Act für Hochrisiko-Systeme als auch im CRA (Cyber Resiliance Act) generell für Produkte mit digitalen Elementen gefordert.

Beratung zu Sicherheitslösungen – in 2 Schritten

- Risikobewertung

Wir beurteilen, welche Gefahren überhaupt relevant sind: von möglichen Data Poisoning Angriffen über die Extraktion sensibler Unternehmensdaten bis hin zu Prompt Injections, um das Verhalten des LLMs zu manipulieren. Bei Bedarf führen wir ein sog. Red Teaming durch, um bestehende KI-basierte Systeme auf gängige Schwachstellen zu prüfen. - Sicherheitslösung

Wir implementieren entsprechende Gegenmaßnahmen. Gängige KI-Lösungen laufen heute in Cloud-Plattformen wie Azure oder Google Cloud. Diese Plattformen bieten bereits Sicherheitsmodule, die konfiguriert und eingesetzt werden können. Diese testen wir regelmäßig und beraten hier gern, wie diese einfach und schnell bei Ihnen eingesetzt werden können.

Nicht immer reichen diese „In-House“-Lösungen aus, da sie nur eine limitierte Angriffsfläche erkennen können. Hier beraten wir gern, welche Lösungen infrage kommen – von Security-Lösungen dedizierter Security-Unternehmen bis hin zu unserem eigenen AI Guard.

Der _fbeta AI Guard

Unsere „AI Firewall“ umfasst einen LLM-Gatekeeper sowie weitere Module, um Angriffe zu erkennen. Anders als viele bestehende Lösungen sind unsere Module auch im deutschen Sprachraum einsetzbar. Der AI Guard prüft automatisch Dokumente auf Data-Poisoning, Prompt Injection und weitere Angriffsmuster – lokal und datenschutzkonform. So bleiben KI-Systeme auch in hochregulierten Branchen wie dem Gesundheitswesen sicher.

Beispiele für gängige Angriffe auf KI-Systeme

- Manipulation des Trainingsdatensatzes („data poisoning“), um zum Beispiel eine Backdoor einzuschleusen in das KI Modell

- Extrahieren vertraulicher Trainingsdaten oder Unternehmensdaten („data leakage“)

- Stehlen des KI-Modells („model theft“)

- Manipulation von Fremd-Bibliotheken und öffentlichen KI-Modellen („supply chain attack“, „model poisoning“)

- Eingabedaten, die das Verhalten des KI-Modells manipulieren („adversarial examples“, „adversarial preprocessing“, „prompt injection“, „jailbreaks“)

- Eingaben, die den Ressourcenverbrauch steigern, mit dem Ziel z. B. wirtschaftlichen Schaden zuzufügen („Energy-Latency Angriffe“)

Das erkennt der _fbeta AI Guard

- Schutz vor Manipulation – Abwehr von Prompt Injections und sogenannten Jailbreaks, um ungewollte oder gefährliche Antworten von LLMs sowie gefährliches Verhalten von KI-Agenten zu verhindern.

- Erkennung vertraulicher Daten – Scan von Eingaben auf sensible Informationen wie API-Schlüssel, Passwörter oder persönliche Daten.

- Unternehmensschutz – Filter, der verhindert, dass interne Dokumente oder Geschäftsgeheimnisse nach außen gelangen.

- Anonymisierungsservice – Automatische Entfernung personenbezogener Informationen (PII).

- Bias-Scanner – Prüfung auf diskriminierende oder voreingenommene Aussagen

- Themen- und Antwortkontrolle – Sicherstellen, dass KI-Antworten nur zu festgelegten Themenbereichen erfolgen. Vermeidung von Antworten, die geschäftlich problematisch sein könnten, etwa das Nennen von Wettbewerbern.

- Sycophancy-Filter – Schutz vor übermäßig bestätigendem oder gefährlich verstärkendem Verhalten des Modells, das falsche Informationen oder riskante Narrative fördern könnte.

- Content-Safety-Check – Erkennung und Blockierung von potenziell schädlichen Inhalten wie Gewalt oder Hassrede.

- Authentizitätsprüfung – Erkennen, ob Inhalte KI-generiert sind; und Schutz vor Deepfake-Inhalten.

RPA | Core Automation

Bei der Core Automation kombinieren wir das Wissens zur Analyse und Bewertung von Prozessen mit Lösungsexpertise (Hyperautomation / KI) und technischem Know-how, diese in oscare® bzw. BITMARCK-Umgebung (21c n/g) umzusetzen. So schaffen wir leichtgewichtige Lösungen, die aufwandsarm umzusetzen sind. Erst die Kombination verschiedener Perspektiven, allen voran der fachliche Input der an den Prozessen beteiligten Organisationseinheiten, schafft die notwendige Informationsgrundlage, um schnelle und umfangreiche Optimierungen zu erreichen.

Sie erhalten:

- Eine fundierte Identifizierung der relevanten Prozesse zur Automatisierung. Diese liefern wir Ihnen auf der Grundlage einer statistischen, technischen und fachlichen Analyse.

- Eine schnelle und präzise Einschätzung der erfolgversprechendsten Technologieauswahl. Unsere umfangreiche Erfahrung im Umgang mit Ihren Kernsystemen und den notwendigen Tools macht dies möglich.

- Unterstützung bei allen technischen und Governance-Aspekten für die Umsetzung der Automatisierung

KI-Sprechstunde

KI klingt spannend, aber Sie wissen nicht, wo Sie anfangen sollen? – Kein Problem! In unserer KI-Sprechstunde sprechen Sie direkt mit unseren Experten – offen, verständlich und ohne Verpflichtungen.

Ganzheitliche Begleitung und spezialisierte Beratung aus einer Hand

Weitere Informationen: fbeta.ai | Innovative KI-Lösung für Business-Anwendungen